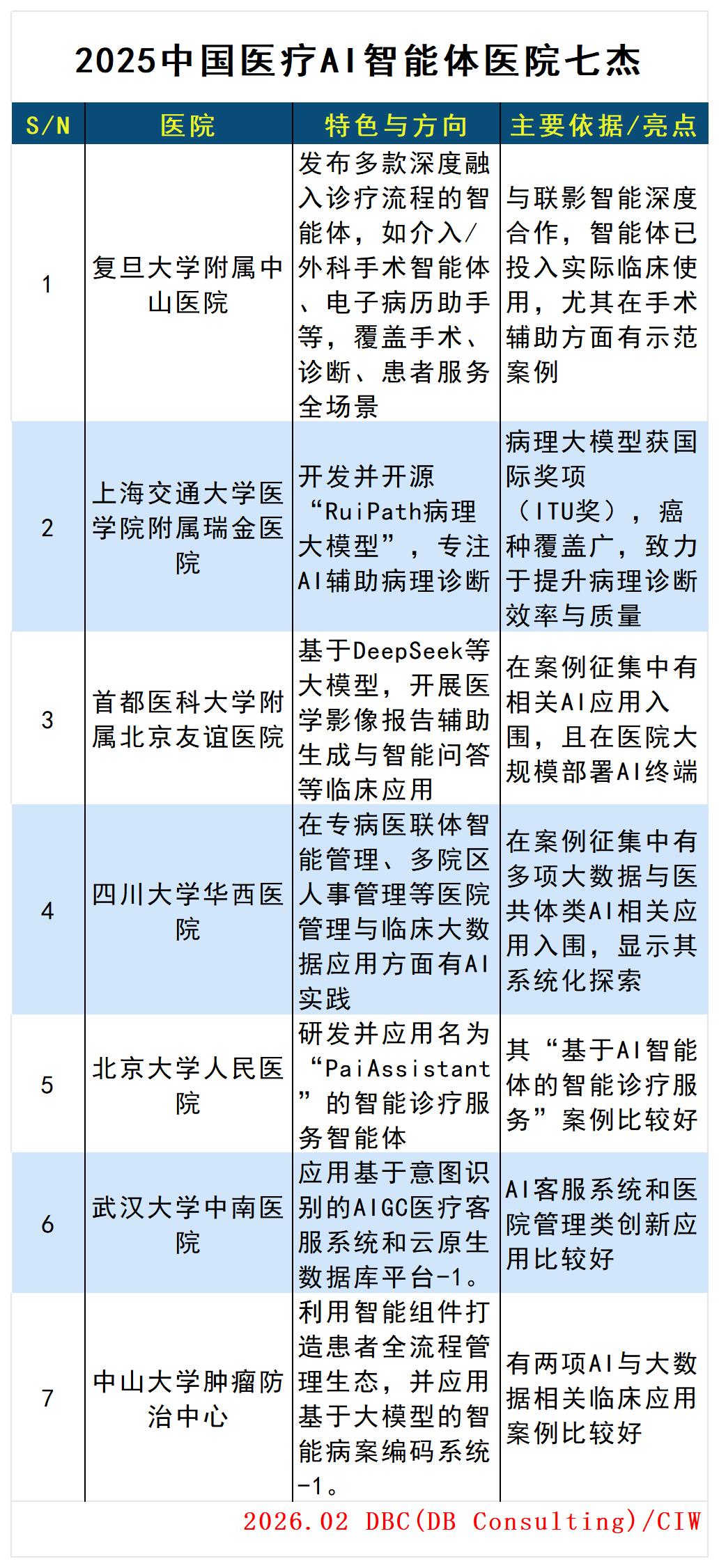

当医学智慧拥抱AI智能体,什么才是关键?当前,中国顶尖医院正以前所未有的热情探索着AI智能体在医疗场景中的应用。然而,当联影智能与顶尖医院合作打造的手术智能体已进入手术室,各大医院竞相展示其AI应用案例之时,一个根本性问题浮现出来:在技术喧嚣之中,什么才是真正重要的核心?

最重要的,是让“智能体”回归“助理”本分医疗AI智能体最重要的定位,不是替代医生,而是成为医生的“超级助理”。这一点在北京友谊医院的应用中体现得尤为明显——他们的AI系统辅助生成影像报告,但最终审阅权始终在医生手中。医疗的核心始终是“人”:医生的临床经验、患者的个体差异、医患之间的信任关系,这些都是冷冰冰的算法无法完全复制的。真正的进步发生在AI能够无缝融入临床工作流,而不是创造另一个需要医生额外花时间学习的孤立系统。

数据质量决定智能高度。瑞金医院开源的“RuiPath病理大模型”之所以受到关注,不仅因为其技术创新,更因为它基于大量高质量的标注病理数据。在医疗AI领域,数据质量直接决定了模型性能的上限。标准化、高质量、多样化的医学数据是训练可靠智能体的基石,而这背后需要医院、研究机构和科技公司之间建立可持续的合作机制与数据治理框架,确保在保护患者隐私的前提下实现数据的合理使用。

临床验证是信任的门槛。武汉大学中南医院将AI用于客服系统,北京大学人民医院的“Pai Assistant”则直接参与诊疗服务——无论应用场景如何,严格的临床验证都是绕不开的关键步骤。面对“AI幻觉”(生成错误但看似合理的医疗信息)这一普遍挑战,智能体需要通过真实世界的临床测试,证明其安全性、有效性和稳定性。这不仅需要技术团队的迭代优化,更需要临床医生的深度参与,共同建立评价标准与使用规范。

技术适应医疗,而非相反。一个常被忽视却至关重要的原则是:AI应该适应现有的医疗环境和流程,而不是反过来要求医疗体系适应技术。中山医院的手术智能体成功的关键,在于它被设计为“辅助者”而非“主导者”,尊重外科医生的决策流程和操作习惯。四川大学华西医院在医联体管理中应用AI时,也充分考虑了下属医院的实际工作条件和能力差异。这种以人为本的技术设计理念,往往比技术本身的先进性更能决定智能体最终能否被接受和使用。

安全是永远不可逾越的红线。医疗AI的安全性是绝对优先项。这包括数据安全(防止患者隐私泄露)、算法安全(避免偏见和歧视性输出)和应用安全(防止因系统故障导致医疗差错)。安全不是一个功能,而是必须融入设计、开发、部署全过程的底层逻辑。

需要构建的是,可持续的“人机共治”新生态。最重要的或许是,我们正在见证一种新型医疗生态系统的形成:医生与AI智能体各展所长,形成“人机共治”的协作模式。医生提供临床经验、伦理判断和人文关怀;AI则处理海量数据、识别潜在模式和完成重复性任务。这种协作不是静态的,而是随着双方能力的提升不断演进——当AI学会更多医疗知识,医生也在学习如何更好地与AI合作。

医疗AI智能体的发展旅程,实际上是一场深刻的医疗体系现代化变革。当技术的光环逐渐褪去,真正持久发挥作用的,将是那些深刻理解医疗本质、尊重临床实践、以患者安全为中心、促进人机协作的智能系统。或许在不久的将来,衡量一家医院智能体“最好”与否的标准,将不再是它运用了多么先进的技术,而是它在多大程度上增强了医疗团队的能力,最终让患者受益。

(文/现场办)

e-Mail:lab@enet16.com